Core Values

고객과 데이터를 가장 깊이 이해하는 AI

질문 의도와 사용자 특성을 종합적으로 분석해, 최적의 맞춤형 답변을 제공합니다.

고품질 의사결정 지원

사용자 질의에 따라 과거 대화 이력을 실시간 조회하고,

해당 문맥의 핵심 내용만 선별·통합 분석하여 더 정교하고

신뢰도 높은 답변을 제공합니다.

AI 상담 신뢰성 향상

6단계 AI 의사결정 과정을 실시간으로 시각화하고,

사용자는 시각화된 검증 결과와 근거를

직관적으로 확인할 수 있습니다.

분석 효율성 극대화

사용자별 메모리를 기반으로 고객별 최적의

분석 경로를 선택해 불필요한 계산을 제거하고

처리 시간을 단축하며, 분석 품질을 향상시킵니다.

Features

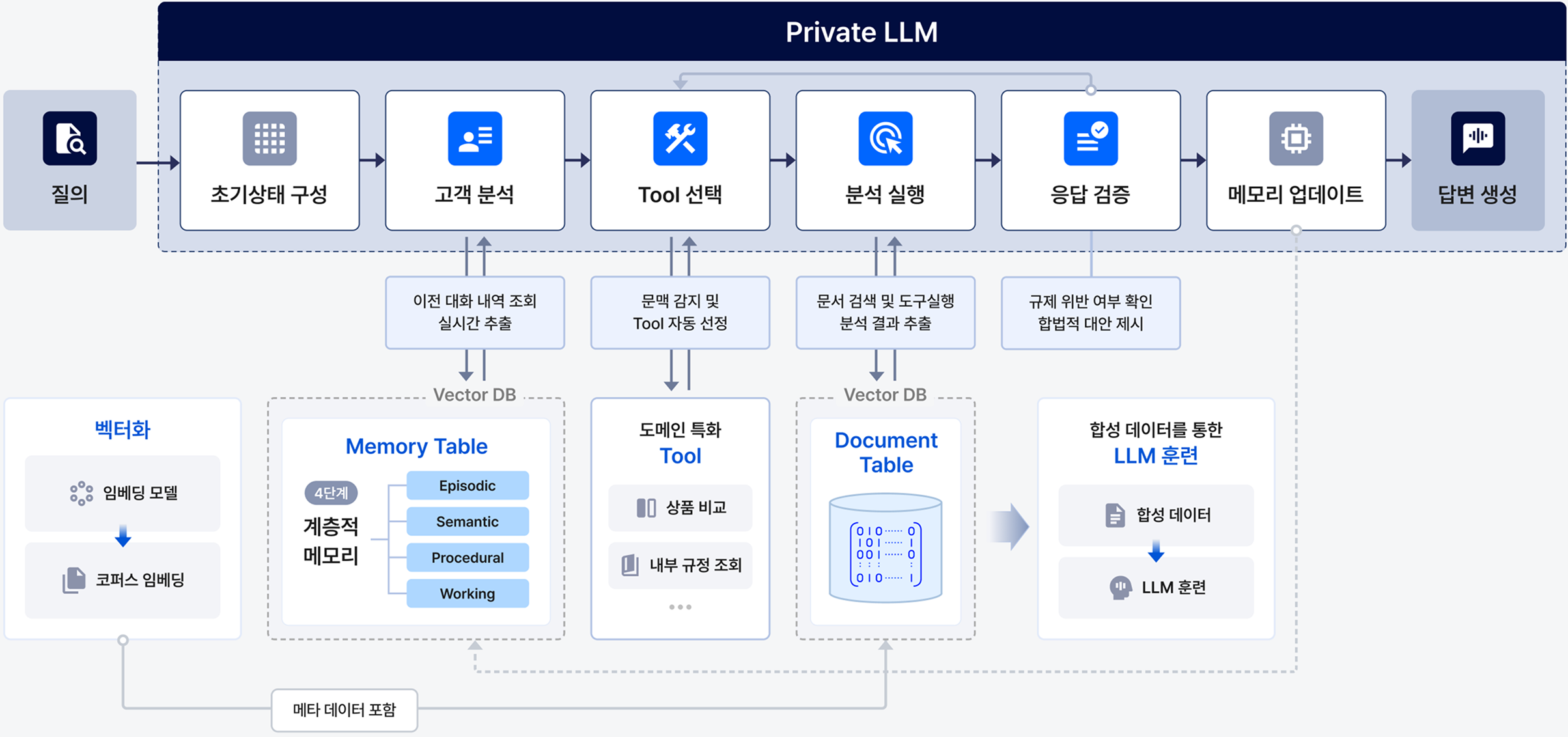

산업 도메인 지식과 폐쇄망 환경에 특화된 Intelligent RAG

가젤 RAG는 자체 메모리 시스템을 기반으로 사용자의 대화 맥락을 실시간으로 파악하고,

필요한 도구를 자동으로 설정·실행하는 스마트 워크플로우를 제공하는 고도화된 개인 맞춤형 질의응답 솔루션입니다.

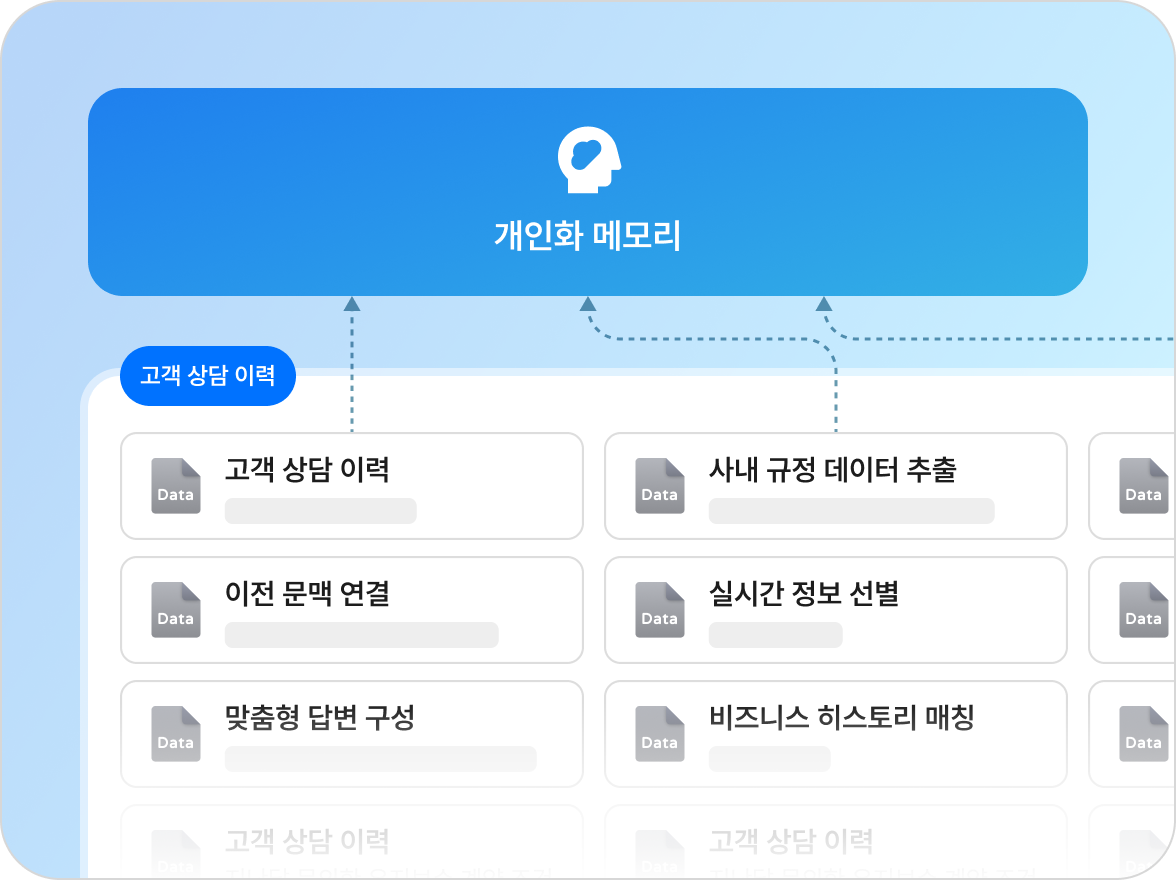

4단계 계층적 메모리 기반

개인화된 메모리 관리

질문과 함께 이전 대화 이력을 조회하여 문맥에 맞는 대화 내용을 선별·추출 후

개인화된 응답을 제공합니다.

6단계 의사 결정 과정 시각화

지능형 Agent 파이프라인

목적 지향의 6단계 의사결정 과정을 실시간으로 시각화하고, 추론 흐름을 단계별로

명확하게 확인할 수 있습니다.

이를 통해 AI 판단 과정의 투명성과 신뢰성을 제공합니다.

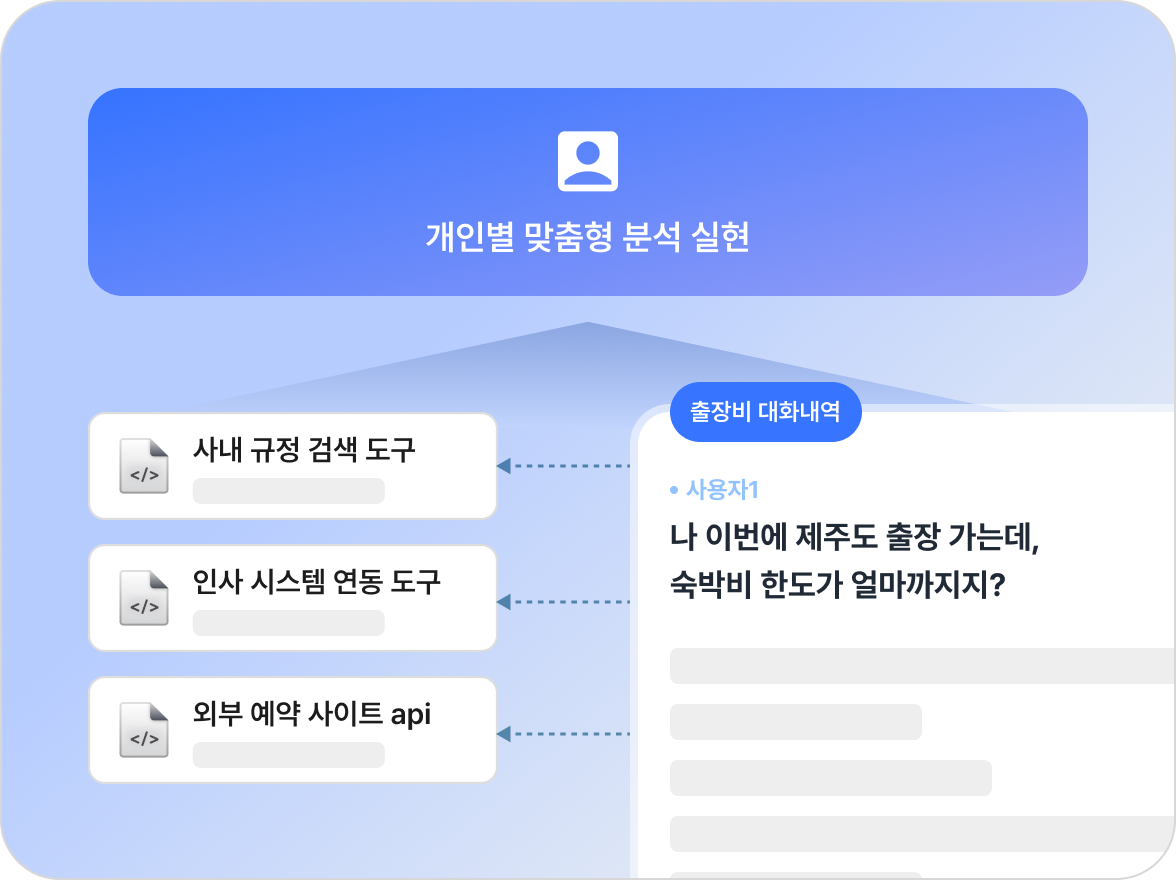

불필요한 분석 과정 제거

문맥인식 도구 선택

고객 메모리와 현재 질의를 통합적으로 분석하고 상황에 맞는 최적의 도구를 자동으로

선택하여 개인별 맞춤형 분석을 정교하게 구현할 수 있습니다.

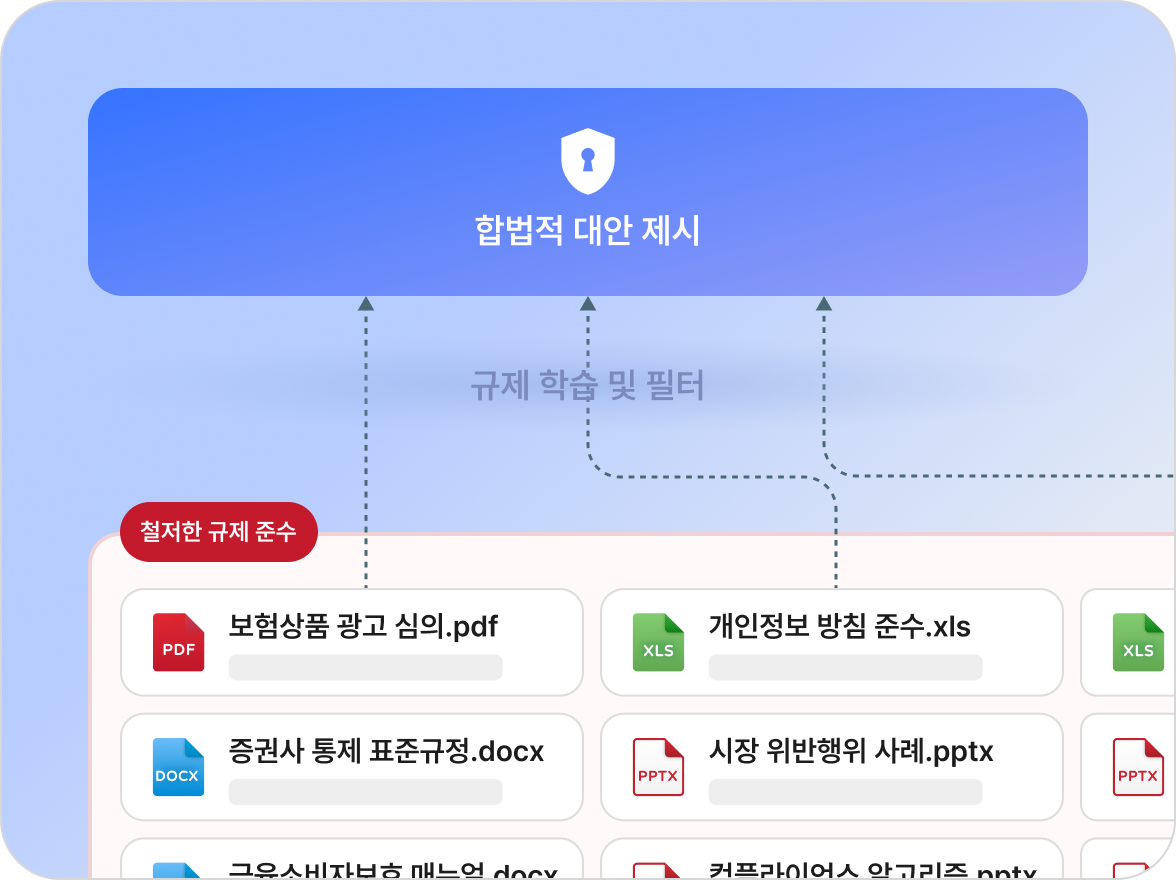

안정적인 RAG 서비스 운영

철저한 규제 준수

보험·증권 등 다양한 산업군의 규제를 반영하여 금지 행위를 자동으로 차단하고,

규제 준수를 통해 안정적인 RAG 서비스 운영 환경을 제공합니다.

Use Case

가젤 RAG는 AI를 활용한 비즈니스 혁신에 기여합니다.

법률/법령 질의응답

다양한 법률과 법령, 사례 등을 기반으로 한 질의응답을 통해 관련 업무를

간소화합니다.

금융/보험상품 분석 비교 및 추천

복잡한 금융상품 약관 분석 및 개인화 메모리를 통해 고객 맞춤형 상품 비교

추천을 지원합니다.

논문/보고서 심화 분석 및 활용

방대한 논문 및 보고서를 빠르게 분석 · 추출하여, 깊이 있는 연구를 가능하게 합니다.

내부지식 기반 질의응답

기업 내 지식을 활용해 정확한 답변을 제공함으로써 업무 효율과 성과를

높여줍니다.

FAQ

자주 묻는 질문